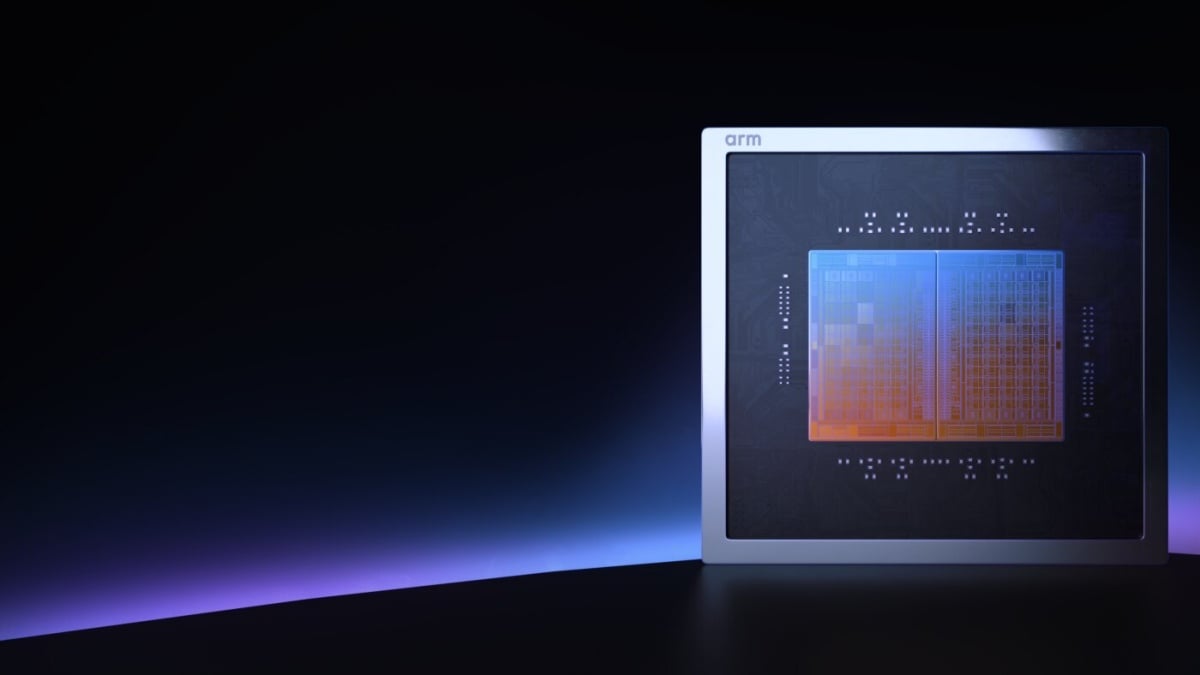

Arm攜手Meta跨足實體晶片推出Arm AGI資料中心CPU,Cloudflare、OpenAI、SAP與SK Telecom也將採用

Arm在創立的35年以來都是作為提供晶片相關IP、運算子系統的供應商,並未跨足實體晶片業務;然而Arm於舊金山的Arm Everywhere event活動宣布首次跨足實體晶片,針對新一代AI基礎設施需求以Neoverse V3架構結合先進高速通道,滿足代理式AI基礎設施所需;Arm表示透過Arm AGI CPU的推出,使Arm客戶可提供自客製化晶片到整合平台方案再到部署Arm設計的處理器等豐富的選擇,生態夥伴可自因應需求選擇合宜的解決方案。

雖然Arm AGI CPU為Arm第一款實體晶片產品,然而在延續Neoverse運算基礎,並獲得超過50家超大規模、雲端運算、晶片、記憶體、網路、軟體、系統設計與製造等跨領域生態夥伴支持。其中Meta不僅作為Arm AGI CPU的共同合作夥伴,也是主要客戶,此外包括erebras、Cloudflare、F5、OpenAI、Positron、Rebellions、SAP以及SK Telecom等也與Arm簽署合約,同時永擎、聯想、廣達與Supermicro皆做為系統商開始接受搭載Arm AGI CPU的系統訂單。

攜手Meta共同開發

Arm AGI CPU是Arm與Meta共同開發,透過Arm AGI CPU針對新一代資料中心需求量身打造的設計,並與Meta自研的Meta Training and Inference Accelerator (MTIA))晶片協同作業,可在大規模AI系統獲得更高效率的排程。此外Arm也提到後續的產品也將持續開發,力求在效能、擴展與效率實現一流的水準,同時也將持續推進Arm Neoverse CSS產品路線,確保以不同方式與Arm合作的資料中心客戶都能持續在平台架構與軟體相容攜手並進。

Arm也為了加速Arm伺服器普及Arm伺服器CPU普及,Arm不僅規劃符合開放運算專案(OCP)與Arm System Ready規範的1OU雙節點參考設計,也將貢獻1OU雙節點參考設計伺服器的設計、配套韌體以及像是系統架構規範、框架與適用於基於Arm架構系統的診斷與驗證工具。

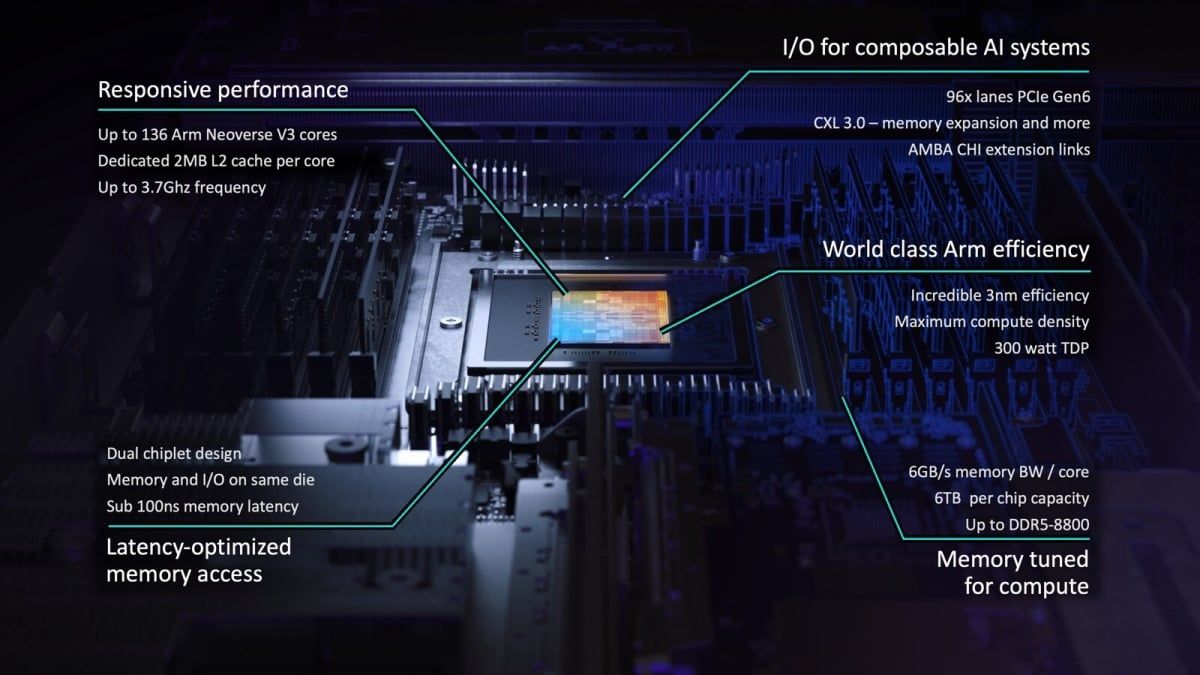

為大規模機架級代理式AI所設計的Arm AGI CPU

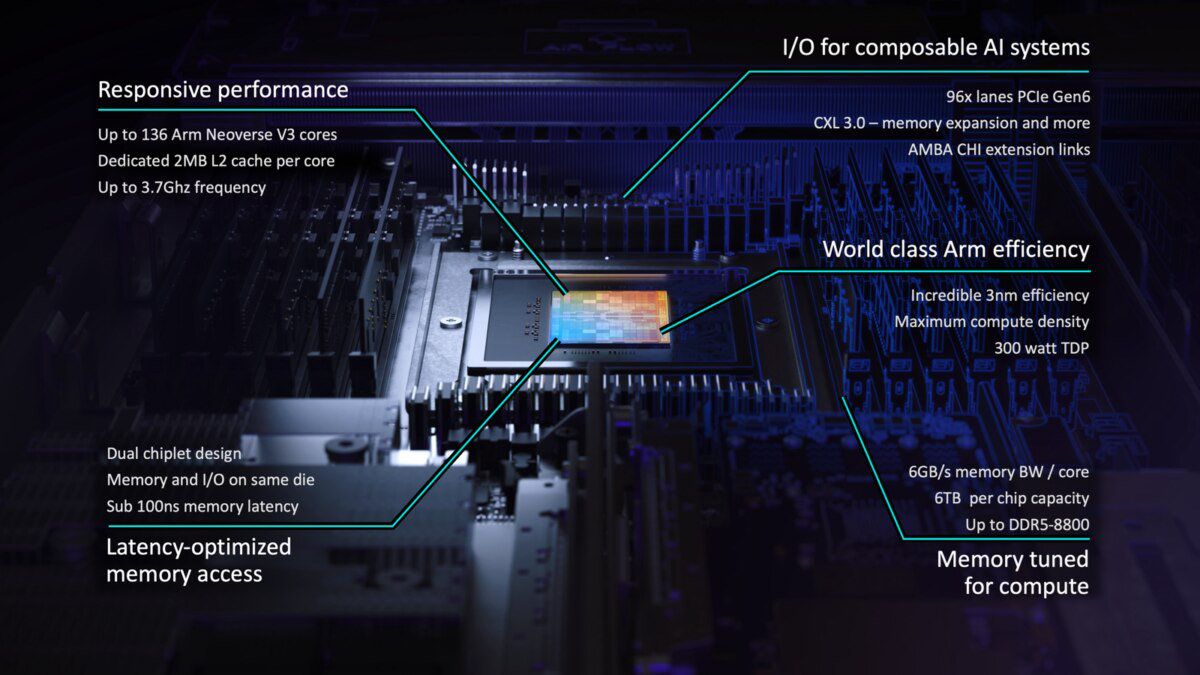

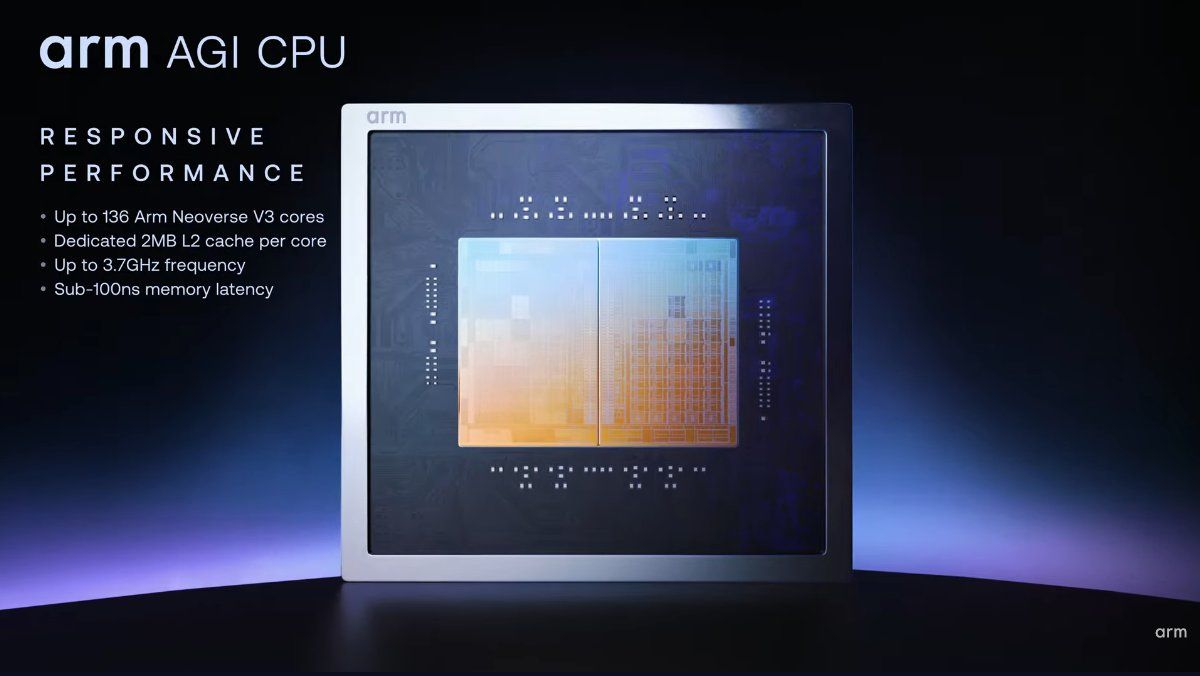

Arm AGI CPU是為新一波AI革新的代理式AI工作負載所需的大規模機架型系統所規劃,旨在能夠並行處理數千個核心,以單一核心單執行緒滿足在長時間高負載下維持峰值性能;每個Arm AGI CPU基於3nm製程,為300W TDP,具有136個3.7GHz的Arm Neoverse V3核心,每個核心具備2MB的L2快取,同時具有96條PCIe Gen 6與支援CXL 3.0以利於記憶體擴展,還有適用於未來晶片與加速器架構的AMBA CHI擴展,此外具有6GB的記憶體頻寬、每個晶片達最高6TB的容量與低於100ns的記憶體延遲,並支援最高DDR5-8800記憶體。

依據Arm所展示的10OU雙節點設計,每個刀鋒伺服器包含2個Arm AGI CPU,每個晶片都有專用的記憶體與I/O控制,使單一刀鋒伺服器具備272個核心與高達12條64GB DDR5記憶體,並以一個標準36kW風冷機架裝載達30個刀鋒伺服器,可提供共8,160個核心;此外Arm還與Supermicro共同開發200kW液冷設計,可容量336個Arm AGI CPU與提供高達45,000個CPU。

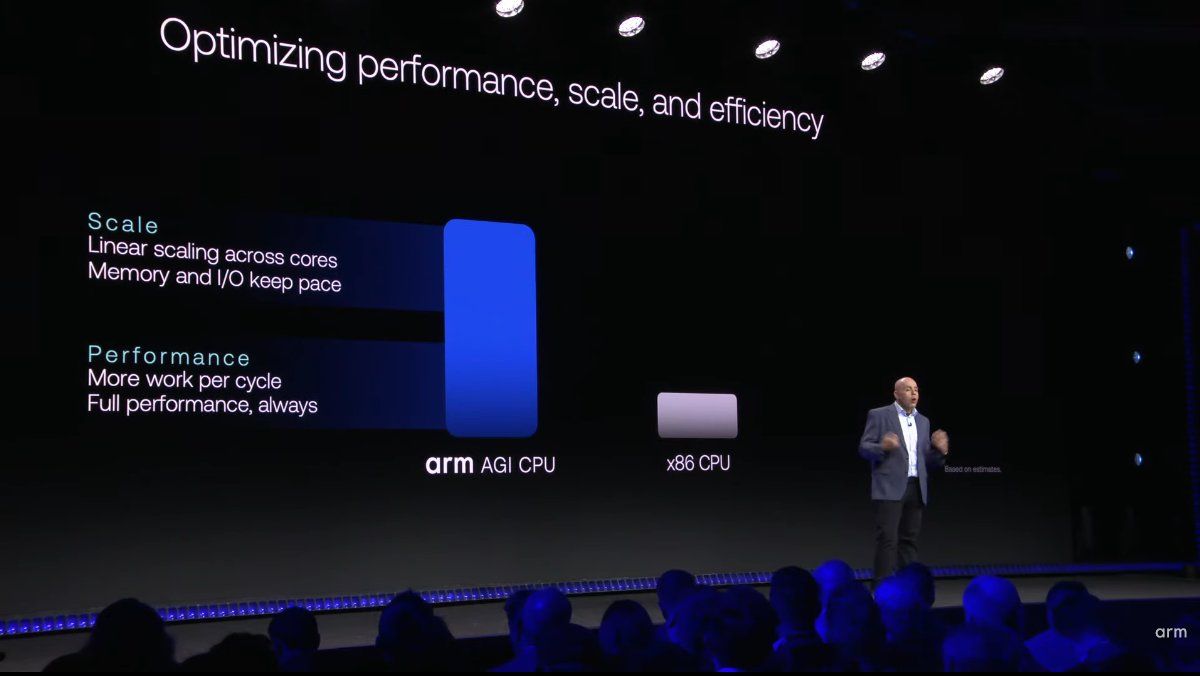

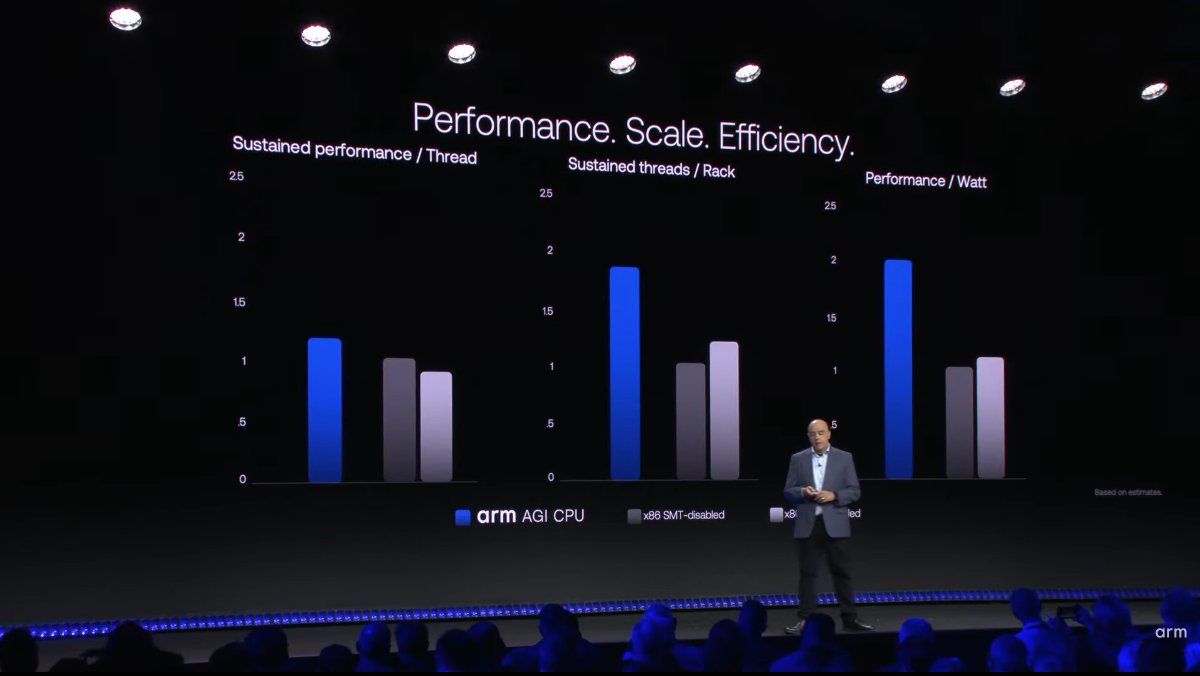

Arm強調在其參考設計下,Arm AGI CPU的每個機架性能對比x86高出2倍,每GW AI資料中心可減少100億美金的資本支出,同時相對x86伺服器受限核心互搶記憶體影響持續效能,Arm AGI CPU更高的記憶體頻寬有助使每個機架執行更多有效執行緒,同時作為基礎的Arm Neoverse V3亦具有相對傳統x86更出色的單執行緒能耗效能表現。

從背後食材供應商、賣調理包走向開代課調理餐廳

筆者以往在描述Arm的業務時,經常把Arm以往提供IP服務的模式敘述為一家食材供應商,客戶需要把這些食材自行烹調才能成為一道菜,但客戶可依據Arm給予的標準食譜或自行調理;當Arm進一步推出運算子系統產品,筆者認為運算子系統則像是調理包,以更速成的方式讓客戶可以快速上菜,但也可以自己幫調理包的成品加菜點綴。

而這次宣布與Meta合作推出Arm AGI CPU,更像是為客戶提供代客料理服務的餐廳,作為食材供應商的Arm依據Meta的需求,以手中的資源與知識,為Meta客製化完成一道Meta所需要的料理。

如果以筆者個人的想法,Arm雖然檯面上是宣布跨足實體晶片業務,但本質上則是為大型客戶提供客製化晶片設計服務,同時把這些產品擴展大型客戶的生態系夥伴;筆者認為Arm此舉除了Meta以外,像是AWS、微軟、Google等直接使用Neoverse CPU IP設計自主處理器的客戶,很有可能進一步轉向此模式與Arm合作打造客製化CPU甚至XPU。

但不同於單純的設計代工業務,Arm並未藏於Meta的招牌下,反而使自己的招牌擺在Meta之前,恐怕與Arm已經成為一家獨立上市公司有關,除了提供新型態的業務服務外,Arm也希冀讓Arm品牌登上實體檯面獲得更多目光的焦點。