Arm 自製晶片搶攻 AI 推論市場 Intel、AMD 面臨新威脅

Arm 正式推出自有品牌「AGI CPU」晶片,採用標準規格瞄準代理式 AI 推論需求,Meta、NVIDIA 等科技巨頭力挺,將衝擊伺服器市場。

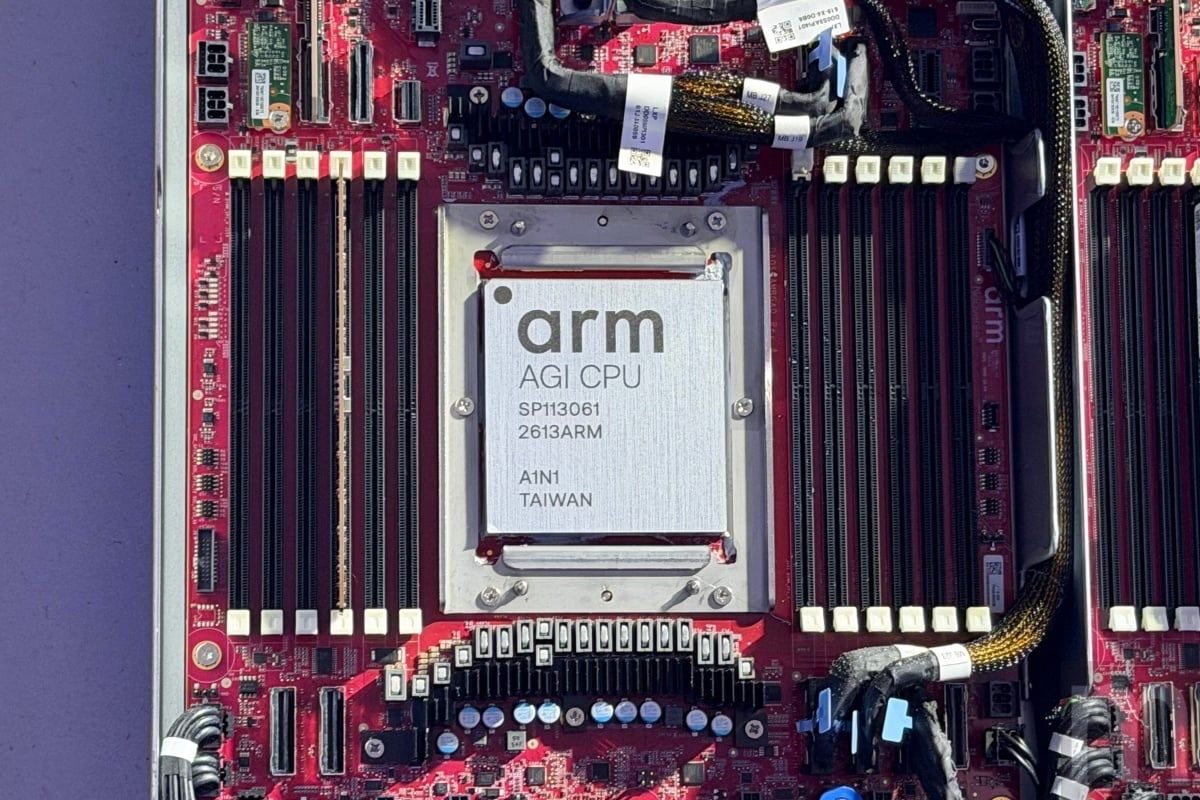

在過去三十多年裡,Arm的商業模式一直都是安分守己地扮演「提供設計圖」的角色,將處理器IP與指令集授權給廣大客戶。然而,近期Arm卻打破傳統,正式端出親自操刀設計、步入量產的實體晶片「Arm AGI CPU」,宣示進軍伺服器運算市場。這項舉動不僅象徵Arm從過往提供IP授權 (零件)、CSS運算子系統 (半成品),正式躍升為能直接提供實體晶片 (成品)的供應商,而外界更關注的是,Arm親自下場做晶片,是否會讓長年稱霸資料中心的Intel與AMD面臨生存危機?又為何Meta、NVIDIA等科技巨頭不僅不擔憂,反而大力支持?

從標準規格切入:以PCIe Gen6與DDR5避開HBM短缺瓶頸

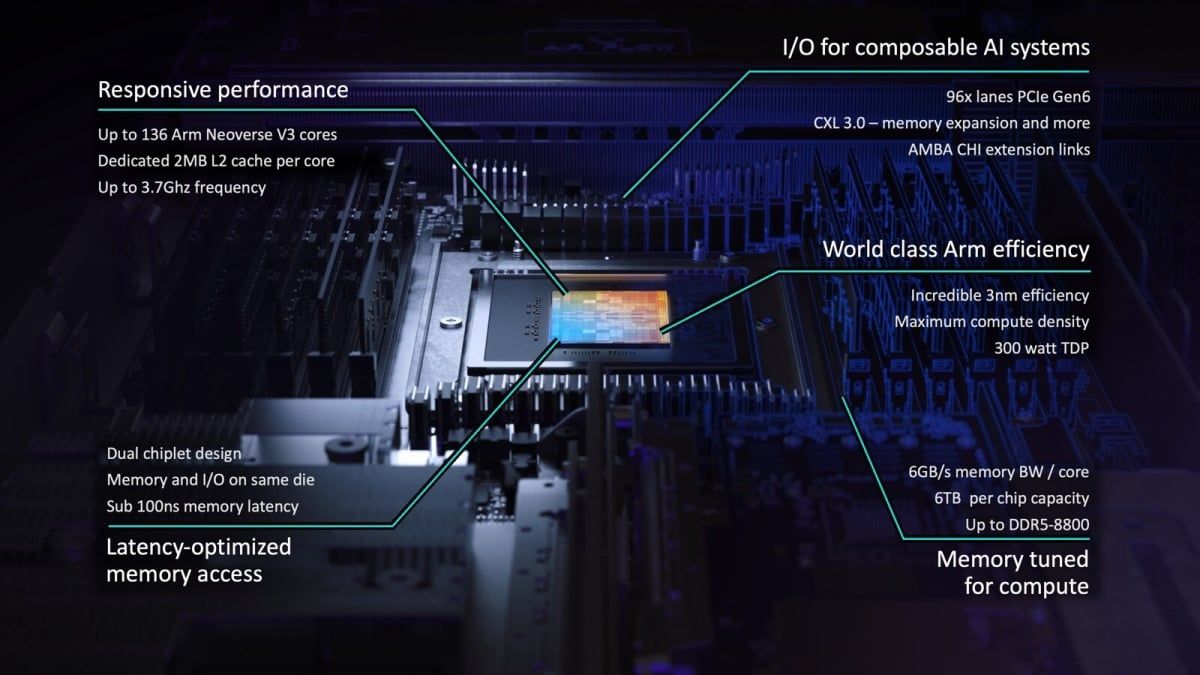

要探討這款晶片的影響力,必須先看懂它的硬體設計思維。Arm AGI CPU並沒有一味追求最高端、最昂貴的特殊封裝規格,而是選擇維持採用PCIe Gen6連接埠與DDR5記憶體標準。

這個決策背後,實際上是相當務實的考量。首先,當前AI市場面臨最嚴重的硬體瓶頸之一,便是HBM高頻寬記憶體嚴重短缺與高昂成本。透過採用成熟的DDR5與標準PCIe Gen6介面,Arm AGI CPU能讓企業與雲端業者以更容易、更具彈性的方式佈署及擴充伺服器叢集。這意味資料中心能在不被特定稀缺料件綁死的情況下,以「標準規格」實現快速建置,直接針對當前海量且急迫的AI推論需求,提供一套相對容易入手的解法。

相關連結:

Arm首度推出自有品牌晶片「Arm AGI CPU」,攜手Meta搶攻代理式AI伺服器商機

詳解Arm首款自製晶片「AGI CPU」架構,單機架對應4.5萬組核心、暴力解救「代理式AI」算力瓶頸

Arm將接續推出多款自有品牌晶片,更暗示將佈局對應更多不同需求的CPU運算市場

衝擊Intel與AMD?提供AI推論市場的「額外選擇」

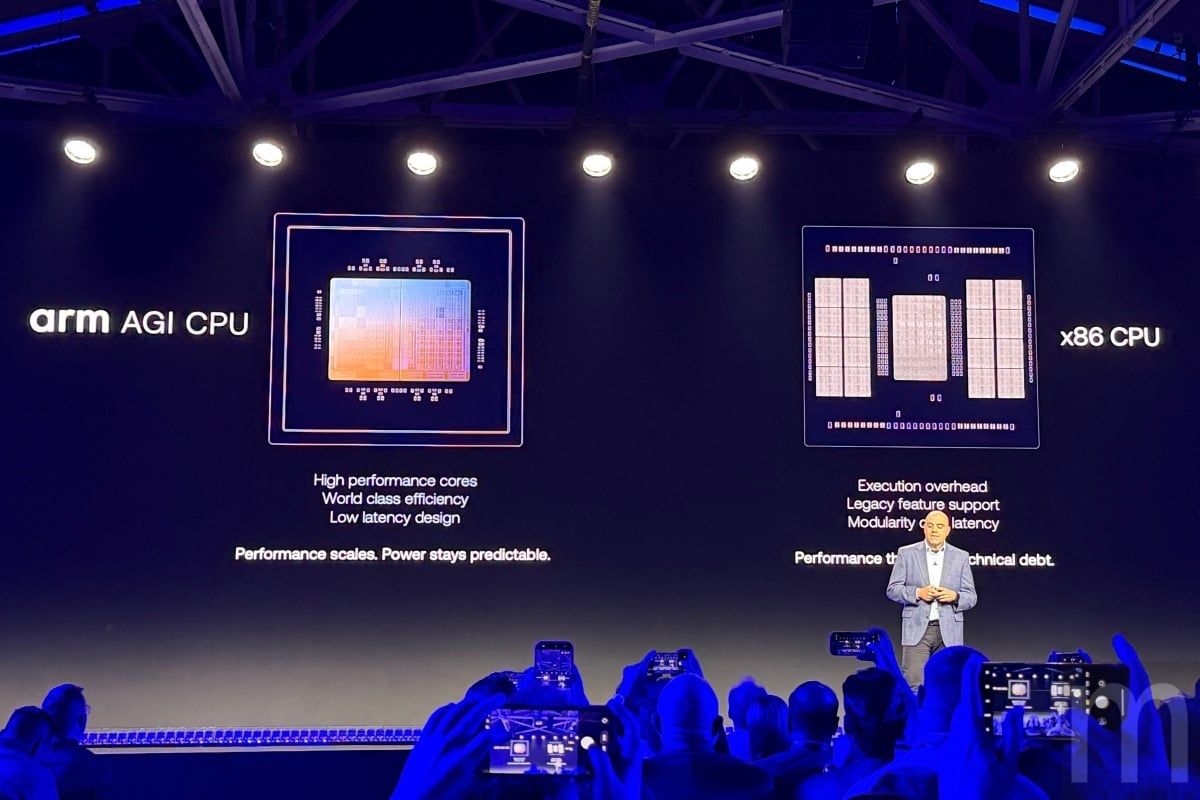

隨著AI發展從單純的模型訓練,走向需要24小時不間斷運作、持續協調任務的「代理式AI」 (Agentic AI),系統所需的推論與資料搬移量呈指數級增長。在這種持續高負載情境下,傳統x86架構處理器功耗過高、容易出現核心爭用與效能衰退的致命傷便容易被放大。

Arm AGI CPU單顆以300W功耗塞入高達136個核心,甚至在液冷機架設計中能達成單機櫃超過4.5萬個核心的驚人密度。這種極致的能效比與高核心密度,確實對Intel與AMD在「AI推論與協調」這塊新興領域造成了直接衝擊。

但這是否代表Intel與AMD將面臨全面潰敗?其實不然。

Arm AGI CPU的定位非常明確,主要是鎖定當前代理式AI的推論與控制節點需求。對於企業內部繁雜的通用運算、傳統雲端服務器架構,以及需要極高單執行緒爆發效能的應用場景,Intel與AMD提供的產品依然擁有無可取代的優勢與生態系底蘊。

因此,Arm的做法與其說是全面取代,不如說是為當前因AI而焦慮的市場,提供了一個兼具更省電、更快佈署優勢的「額外選擇」。這也是為什麼市場對於Arm針對推論需求推出專屬處理器,多半抱持樂觀看待,因為實際上它只衝擊到了特定需求的一部分。

填補算力拼圖,Meta與NVIDIA為何力挺?

Arm跳下來做晶片,最怕的理應是既有客戶反彈,但結果卻是Meta成為首發聯合開發夥伴,包含NVIDIA在內等多家科技巨頭也表態支持。尤其像Meta的線上社群服務平台如Facebook、Instagram等,能藉由AGI CPU多運算核心、低耗電等特性,以更有效率形式運作。而像是AI運算、虛擬化應用服務,甚至雲端服務業者,同樣也能藉由AGI CPU特性、結合Arm軟體框架提升運作速度。

而對於Meta這類積極發展自研AI加速晶片 (如MTIA)的巨頭,他們迫切需要一種極度高效、能管理海量加速器且不會造成過度耗電的「大腦」,而Arm AGI CPU正好完美勝任這個協調者的角色。至於對NVIDIA等業者而言,Arm提供更節能的CPU來搭配AI加速叢集,反而有助於緩解整體資料中心的電力焦慮,讓客戶能把珍貴的電力預算留給主要的運算單元。Arm AGI CPU不僅沒有動到巨頭們的命脈,反而幫他們解決了基礎設施擴張的痛點。

不只是短期目標,Arm的長遠晶片藍圖與野心

這款晶片的推出絕對不是一次性的火力展示。Arm執行長Rene Haas已經明確透露,內部已經在著手準備「Arm AGI CPU 2」,以及後續的「Arm AGI CPU 3」等產品,這份公開的產品發展藍圖,更是強調Arm的自有品牌晶片計畫是一項長遠發展的戰略佈局,而非短期過客。

更引人遐想的是,團隊也正考慮針對AGI CPU以外的用途構思產品。這意味著Arm未來的自有品牌晶片不僅可能跨足更廣泛的CPU運算市場,甚至不排除將觸角延伸涵蓋至GPU產品領域。從幕後的IP授權提供者,到如今走向前台端出自有品牌晶片,Arm接下來希望在市場扮演的,顯然是能提供完整解決方案、更具主導性的硬體規格制定者角色。