Google TurboQuant記憶體壓縮技術重演DeepSeek對AI算力誤解,AI產業仍對記憶體趨之若鶩

Google公布一篇能夠透過壓縮技術降低AI對記憶體的用量、進而提升記憶體效率的Google TurboQuant記憶體壓縮技術論文,結果引發外界各種過度解讀,表示AI產業不再需要大量的記憶體,導致出現一波記憶體拋售的情況;然而整體產業、甚至連發表技術論文的開發者都對市場反應感到震驚,因為實際上AI產業仍對記憶體趨之若鶩。

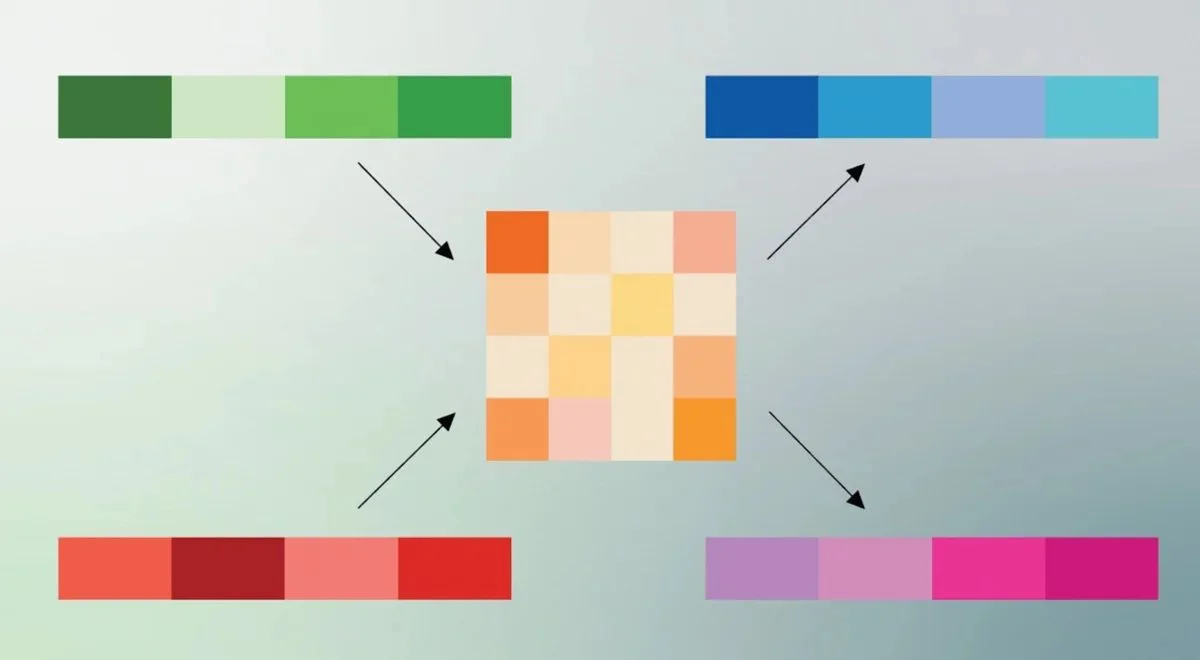

雖然Google TurboQuant可更有效率的在AI技術提升記憶體使用效率,但不代表產業對於AI的需求會下降,以結果來說,更好的使用效率不代表僅有減少對記憶體的依賴,實際上也表示在相同的記憶體用量有更好的品質,而多半情況則會評估終端裝置的情況進行抉擇。

若從現實考量,當前的AI技術正面臨從生成式AI轉化到代理式AI、並從AI模型訓練轉化到落地普及到基礎設施與裝置,意味著除了原本就持續存在需求的訓練型基礎設施,大宗的推論基礎設備也仍持續需要大量的記憶體,尤其隨著多模態模型當中的專家混合模型(MoE)成為顯學,記憶體的需求也難以減緩。

多家大型記憶體供應商的AI客戶記憶體訂單仍顯示相關業者完全不受Google TurboQuant技術影響,產能仍跟不上訂單需求,這也表示長期來看市場上的記憶體仍難以回到2025年上半年的情況,記憶體業者仍是這波AI熱潮的贏家;而且看似由於相關新聞引起的記憶體拋售,記憶體的價格也仍高於2025年上半年。

從結果來說,Google TurboQuant引發的市場效應如同當時DeepSeek問世引發市場一面倒認為模型蒸餾減少對AI基礎設施的需求一樣,皆是有意或無意之間的錯誤解讀引發的短期結果,一段時間後仍會看到記憶體依舊持續產能不足的現實情況。

更有效率的使用記憶體的情況可以類比成當你工作效率變好的時後,普遍的老闆不會叫你提前下班,而是交代給你更多工作。